Modèles de raisonnement IA en 2026 : o3, Claude Opus, Gemini 2.5, DeepSeek R1 — Le guide complet

Ikasia, cabinet de conseil et formation IA à Paris, décrypte les avancées des modèles de raisonnement IA pour les entreprises françaises. En 2026, les modèles comme o3 (OpenAI), Claude Opus 4.6 (Anthropic), Gemini 2.5 Pro (Google) et DeepSeek R1 sont devenus incontournables pour les tâches complexes en entreprise.

En bref : Les modèles de raisonnement (o3, Claude Opus, Gemini 2.5, DeepSeek R1) réduisent significativement les erreurs sur les tâches complexes. Chaque acteur a sa philosophie : modèles séparés (OpenAI), mode hybride (Anthropic), thinking intégré (Google), open-source (DeepSeek). Pour un comparatif complet des principaux LLMs, consultez notre guide dédié.

Ce guide fait le point sur l'état de l'art en février 2026.

Qu'est-ce qu'un modèle de raisonnement ?

Un modèle de raisonnement est un LLM entraîné pour décomposer les problèmes complexes en étapes intermédiaires avant de fournir une réponse finale. C'est le paradigme du "test-time compute" : au lieu de rendre le modèle plus gros, on le laisse réfléchir plus longtemps.

Différence fondamentale avec un LLM classique

LLM classique (GPT-4o) :

Input: "Combien font 17 × 24 ?"

Output: "408" (réponse directe, parfois fausse)

Modèle de raisonnement (o3) :

Input: "Combien font 17 × 24 ?"

Thinking:

- Je décompose : 17 × 24 = 17 × (20 + 4)

- 17 × 20 = 340

- 17 × 4 = 68

- 340 + 68 = 408

Output: "408"

Le modèle génère explicitement sa chaîne de pensée (Chain-of-Thought) avant de conclure. Résultat : des gains massifs en maths, code, logique et analyse complexe.

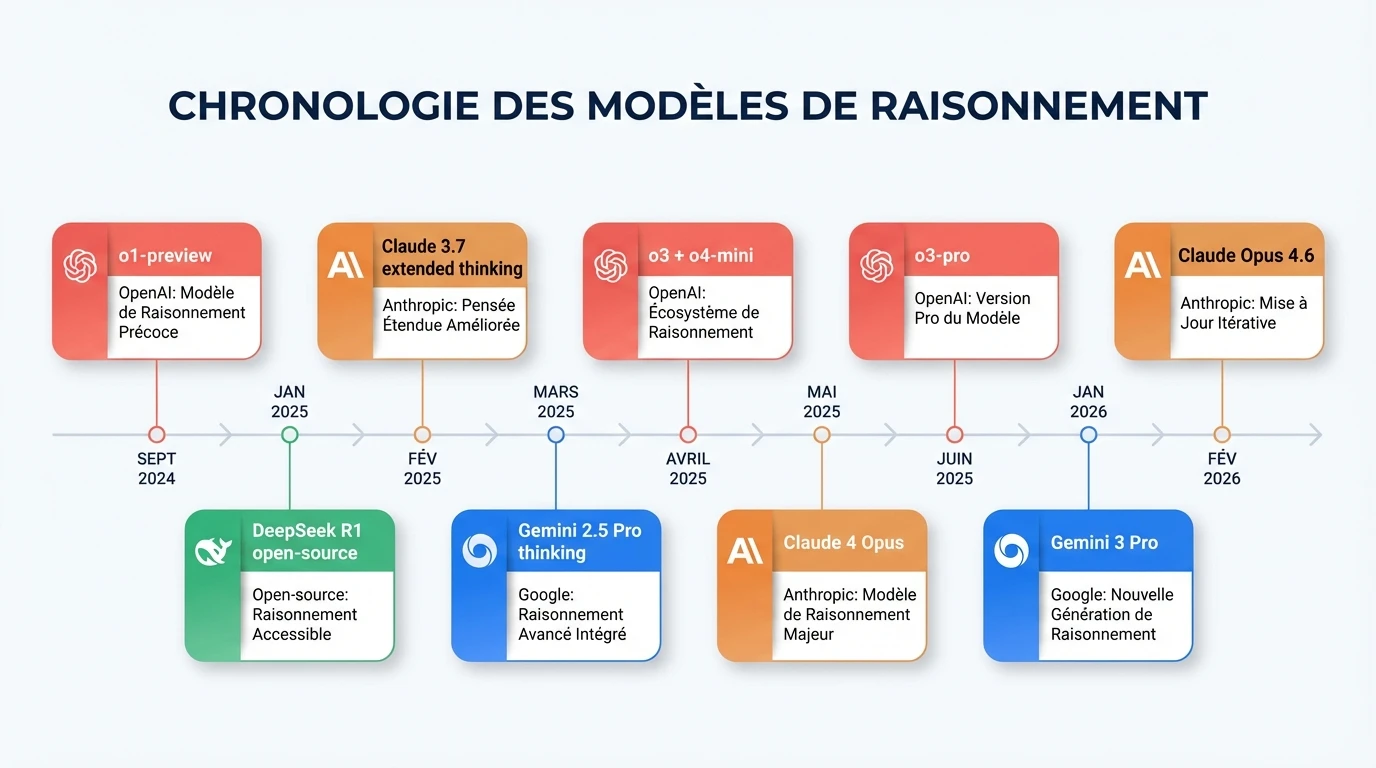

La course au raisonnement : chronologie complète

L'adoption a été fulgurante — en 6 mois, tous les grands acteurs ont suivi OpenAI.

Septembre 2024 — OpenAI lance o1-preview

Premier modèle de raisonnement commercial. Version limitée, mais démontrant le potentiel : 83% sur MATH (vs 60% pour GPT-4).

Janvier 2025 — DeepSeek R1 choque l'industrie

L'événement de l'année. DeepSeek publie en open-source (licence MIT) un modèle de raisonnement compétitif avec o1. Impact boursier immédiat : Nvidia perd ~600 milliards USD de capitalisation. DeepSeek prouve que le raisonnement n'exige pas une infrastructure propriétaire massive.

Février 2025 — Anthropic entre dans la course

Claude 3.7 Sonnet introduit l'extended thinking : un même modèle peut fonctionner en mode standard OU en mode raisonnement approfondi. Approche "hybride" différente d'OpenAI.

Mars 2025 — Google Gemini 2.5 Pro

Google lance son meilleur modèle de raisonnement avec une fenêtre de contexte de 1 million de tokens — inégalée. Le "thinking" est intégré directement dans Gemini, activable via toggle.

Avril 2025 — o3 et o4-mini, le nouveau SOTA

OpenAI reprend la tête avec o3 (87.5% sur ARC-AGI, un test de raisonnement général) et o4-mini (excellent rapport qualité/prix). Pour la première fois, les modèles de raisonnement peuvent utiliser des outils (recherche web, code, vision).

Mai 2025 — Claude 4 Opus

Anthropic répond avec Claude 4 Opus, son modèle le plus puissant. SWE-bench Verified ~72%, compétitif avec o3.

Juin 2025 — o3-pro

Version "pro" d'o3 avec encore plus de compute par requête. 90%+ sur GPQA Diamond. D'abord réservé à ChatGPT Pro ($200/mois), puis étendu à l'API.

Janvier 2026 — Gemini 3 Pro

Google passe à la génération suivante. 74.2% sur Humanity's Last Exam, le benchmark le plus difficile du moment.

Février 2026 — Claude Opus 4.6

Anthropic lance Claude Opus 4.6 avec le raisonnement adaptatif : le modèle décide lui-même quand et combien réfléchir. Contexte de 1M tokens en bêta. Quatre niveaux d'effort (low, medium, high, max).

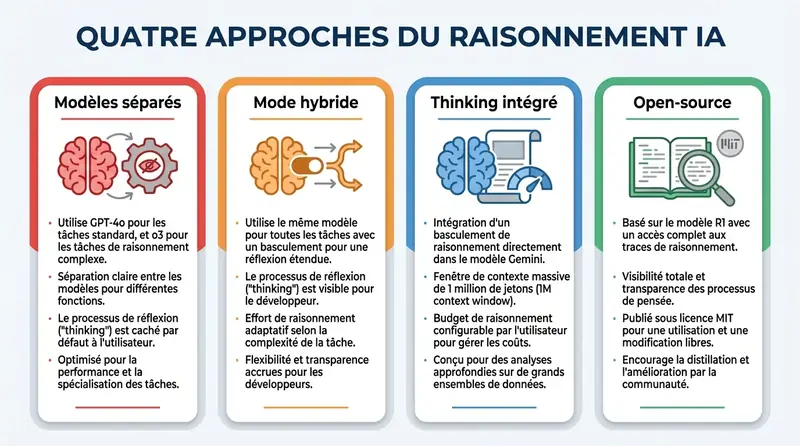

Quatre approches, quatre philosophies

Chaque acteur a adopté une stratégie différente pour intégrer le raisonnement.

OpenAI : Modèles séparés

- Famille GPT pour l'usage standard (GPT-4o, GPT-5)

- Famille o-series pour le raisonnement (o3, o4-mini, o3-pro)

- Thinking tokens cachés par défaut

- Paramètre

reasoning_effort(low/medium/high)

Anthropic : Mode hybride

- Un même modèle (Claude Opus 4.6) peut répondre vite OU réfléchir en profondeur

- Extended thinking activable, avec budget de tokens configurable

- Thinking visible pour le développeur (auditabilité)

- Raisonnement adaptatif : le modèle décide dynamiquement (nouveau en 4.6)

Google : Thinking intégré

- Gemini 2.5 Pro/Flash avec toggle thinking on/off

- Budget de thinking configurable

- 1M tokens de contexte — idéal pour l'analyse de documents massifs

- Deep Research pour la recherche multi-étapes

DeepSeek : Open-source

- R1 publié sous licence MIT, entièrement reproductible

- Raisonnement entraîné via reinforcement learning pur (minimal SFT)

- Modèles distillés disponibles (7B à 70B paramètres)

- Chaînes de raisonnement complètement visibles

- Coût API imbattable ($0.55/M input)

Benchmarks comparatifs (février 2026)

| Benchmark | o3 | o3-pro | o4-mini | Claude Opus 4.6 | Gemini 2.5 Pro | DeepSeek R1 |

|---|---|---|---|---|---|---|

| AIME 2025 (maths) | 96.7% | ~97% | 92.7% | ~85% | ~86% | 87.5% |

| GPQA Diamond (science) | 87.7% | 90.2% | 81% | ~83% | 84% | 71.5% |

| SWE-bench (code réel) | 69.1% | ~70% | 68.1% | ~72% | 63.8% | ~49% |

| ARC-AGI (raisonnement) | 87.5% | — | 68% | — | ~55% | — |

| MATH-500 | ~97% | ~98% | 96% | ~92% | 92% | 97.3% |

| HumanEval (code) | 92% | 93% | 93% | 93%+ | 90% | 90% |

Points clés :

- o3 domine sur le raisonnement pur (ARC-AGI, AIME)

- Claude Opus excelle sur le code réel (SWE-bench) et les documents longs

- DeepSeek R1 rivalise sur les maths pures à une fraction du coût

- Gemini 2.5 Pro offre le meilleur contexte (1M tokens) et un bon équilibre global

Le coût de la réflexion : thinking tokens

Chaque étape de raisonnement consomme des tokens de réflexion. Ces tokens sont facturés au prix des tokens de sortie et peuvent représenter 5 à 20 fois plus que la réponse finale.

| Modèle | Input (/M tokens) | Output (/M tokens) | Contexte |

|---|---|---|---|

| GPT-4o | $2.50 | $10 | 128K |

| o3 | $10 | $40 | 200K |

| o4-mini | $1.10 | $4.40 | 200K |

| Claude Opus 4.6 | $15 | $75 | 200K (1M bêta) |

| Gemini 2.5 Pro | $1.25 | $10 | 1M |

| DeepSeek R1 | $0.55 | $2.19 | 128K |

À retenir : Un appel o3 en mode "high" peut coûter 10 à 50x plus qu'un appel GPT-4o pour la même question. Mais o4-mini et DeepSeek R1 rendent le raisonnement accessible à des prix proches des modèles standards.

Cas d'usage : quand utiliser un modèle de raisonnement

Recommandés

1. Mathématiques et modélisation financière Problèmes multi-étapes, analyses statistiques, projections. o3 et DeepSeek R1 excellent ici.

2. Code et debugging complexe Conception d'algorithmes, revue de code, debugging. Claude Opus et o3 sont les meilleurs sur SWE-bench.

3. Analyse juridique et contractuelle Analyse de clauses, identification de risques, raisonnement basé sur la jurisprudence.

4. Recherche scientifique Formulation d'hypothèses, analyse de données expérimentales, revue de littérature.

5. Planification et stratégie Plans projet, analyses multicritères, scénarios what-if. Les agents IA autonomes exploitent particulièrement ces capacités de raisonnement.

Non recommandés

- Génération de contenu créatif → GPT-4o ou Claude Sonnet (plus rapides, moins chers)

- Tâches simples et répétitives → Extraction d'entités, résumés basiques

- Applications temps-réel → La latence de 10-30s est incompatible avec les chatbots conversationnels

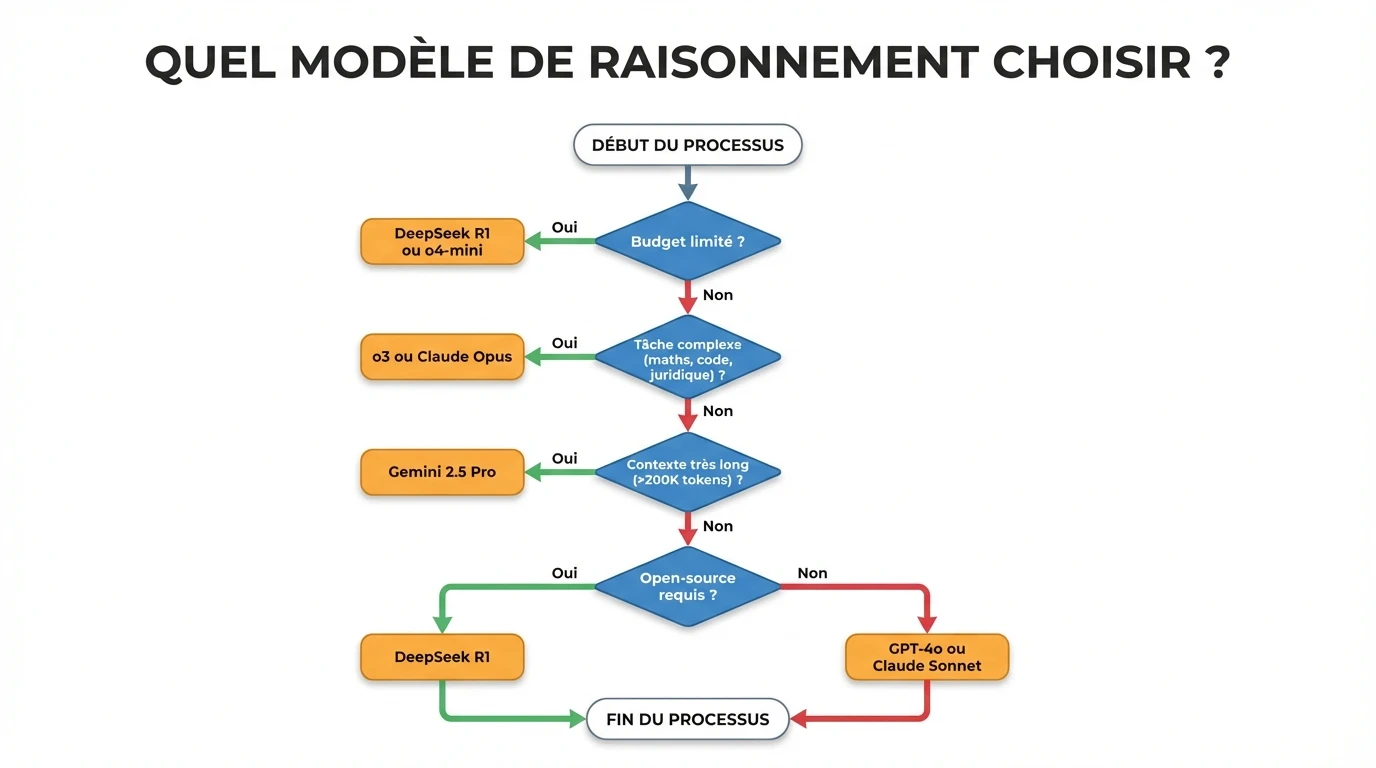

Quel modèle choisir ? Guide de décision

| Critère | o3 | o4-mini | Claude Opus 4.6 | Gemini 2.5 Pro | DeepSeek R1 |

|---|---|---|---|---|---|

| Force | Raisonnement pur | Rapport qualité/prix | Code réel, documents | Contexte 1M, multimodal | Open-source, coût |

| Latence | 10-30s | 3-10s | 5-20s | 5-15s | 5-20s |

| Coût | $$$$$ | $$ | $$$$$ | $$$ | $ |

| Open-source | Non | Non | Non | Non | Oui |

| Meilleur pour | Maths, logique | Usage quotidien raisonné | Analyse, coding agent | Documents longs | Budget serré, on-premise |

Architecture recommandée : Router intelligent

Pour optimiser coût et performance, implémentez un router :

def route_request(query, complexity_score, context_length):

if context_length > 200_000:

return "gemini-2.5-pro" # Seul à gérer 1M tokens

elif complexity_score < 0.3:

return "gpt-4o-mini" # Simple, rapide, pas cher

elif complexity_score < 0.6:

return "o4-mini" # Bon raisonnement, coût modéré

elif complexity_score < 0.8:

return "claude-opus-4-6" # Excellent sur code et analyse

else:

return "o3" # Raisonnement maximal

Limites et précautions

1. Raisonnement ≠ Vérité

Le modèle peut produire un raisonnement logiquement cohérent mais factuellement faux. Une chaîne de pensée convaincante n'est pas une garantie de véracité. Les approches RAG vs fine-tuning permettent de réduire ces hallucinations en ancrant le modèle dans des données vérifiées.

2. Coût significatif

Un appel o3 en mode "high" reste 10 à 50x plus cher qu'un appel standard. Réservez le raisonnement aux cas qui le justifient.

3. Latence

10-30 secondes de réflexion = incompatible avec un chatbot conversationnel. Le raisonnement adaptatif de Claude Opus 4.6 atténue ce problème en ne réfléchissant que quand c'est nécessaire.

4. Opacité variable

OpenAI cache les thinking tokens par défaut. Anthropic et DeepSeek les exposent. Pour les applications nécessitant une auditabilité (santé, juridique), privilégiez les modèles avec raisonnement visible.

Comment tester les modèles de raisonnement

OpenAI o3 / o4-mini

from openai import OpenAI

client = OpenAI()

response = client.chat.completions.create(

model="o3", # ou "o4-mini"

messages=[{"role": "user", "content": "Résous ce problème étape par étape..."}],

reasoning_effort="medium" # low, medium, high

)

Claude Opus avec extended thinking

import anthropic

client = anthropic.Anthropic()

response = client.messages.create(

model="claude-opus-4-6-20250205",

max_tokens=16000,

thinking={

"type": "enabled",

"budget_tokens": 10000 # budget de réflexion

},

messages=[{"role": "user", "content": "Analyse ce contrat..."}]

)

DeepSeek R1 (compatible OpenAI)

from openai import OpenAI

client = OpenAI(base_url="https://api.deepseek.com", api_key="...")

response = client.chat.completions.create(

model="deepseek-reasoner",

messages=[{"role": "user", "content": "Prouve ce théorème..."}]

)

# response.choices[0].message.reasoning_content contient la chaîne de pensée

Ce que ça change pour les entreprises

Le "Reasoning Engineering" remplace le Prompt Engineering

Au-delà du prompt classique, il faut désormais :

- Calibrer le niveau de réflexion selon la tâche (low → max) — voir notre guide sur le prompt engineering avancé (RSIP, MPS)

- Choisir le bon modèle pour le bon problème (routing)

- Valider la chaîne de raisonnement, pas seulement la réponse finale

- Optimiser les coûts avec des modèles comme o4-mini pour le quotidien

Métiers les plus impactés

- Analystes financiers : modélisation complexe avec justification étape par étape

- Avocats et juristes : analyse contractuelle avec raisonnement juridique explicite

- Data Scientists : debugging et optimisation d'algorithmes ML

- Chercheurs : formulation d'hypothèses et analyse de données

Notre formation sur les modèles de raisonnement

Chez Ikasia, nous proposons :

Atelier "Maîtriser les modèles de raisonnement" (3h30)

- Comprendre Chain-of-Thought et ses variantes (o3, Claude, Gemini, DeepSeek)

- Cas pratiques : maths, code, analyse juridique

- Optimisation coût/performance avec routing intelligent

Formation "Architecture LLM Avancée" (2 jours)

- Intégration API des modèles de raisonnement (OpenAI, Anthropic, Google, DeepSeek)

- Design patterns pour applications de raisonnement

- Monitoring, observabilité et auditabilité des chaînes de pensée — s'appuyant sur les outils et frameworks ML de référence

Voir nos formations | Demander un devis

Conclusion

En 18 mois, le raisonnement est devenu un standard de l'industrie IA. Ce n'est plus un avantage compétitif d'un seul acteur — c'est une capacité fondamentale que chaque fournisseur implémente à sa manière.

La clé pour les entreprises ? Orchestrer intelligemment :

- o4-mini ou DeepSeek R1 pour le raisonnement quotidien à bas coût

- o3 ou Claude Opus pour les tâches critiques nécessitant une précision maximale

- Gemini 2.5 Pro pour l'analyse de documents massifs

- GPT-4o ou Claude Sonnet pour les tâches standards ne nécessitant pas de raisonnement

L'avenir de l'IA n'est pas un modèle unique, mais une orchestration intelligente de modèles spécialisés. Et les modèles de raisonnement en sont la pierre angulaire.

Cet article vous a intéressé ? Découvrez notre Formation Stratégie IA pour Dirigeants — 2 jours pour piloter l'IA dans votre organisation.

Tags

Formations associées

Articles similaires

Hiérarchie des instructions dans les LLMs : comment OpenAI renforce la sécurité et le contrôle des IA en entreprise

Lire

ChatGPT, Claude ou Gemini : Quel LLM choisir pour votre entreprise en 2026 ?

Lire

GPT-5.5 Instant : Ce que le nouveau modèle d'OpenAI change concrètement pour vos équipes et vos processus

LireEnvie d'aller plus loin ?

Ikasia propose des formations IA conçues pour les professionnels. De la stratégie aux ateliers techniques pratiques.