OpenAI Safety Fellowship : Ce que la sécurité de l'IA signifie concrètement pour les entreprises françaises

L'annonce du OpenAI Safety Fellowship marque un tournant dans la manière dont les grandes organisations technologiques abordent la question de la fiabilité et de l'alignement des systèmes d'intelligence artificielle. Pour les entreprises françaises, souvent tiraillées entre l'urgence d'adopter l'IA et la nécessité de le faire de façon responsable, ce signal venu de San Francisco mérite une attention particulière. Car derrière ce programme académique se cachent des implications très concrètes pour vos opérations, vos équipes et votre gouvernance.

Qu'est-ce que l'OpenAI Safety Fellowship et pourquoi ça compte ?

Le OpenAI Safety Fellowship est un programme pilote destiné à financer et structurer la recherche indépendante sur la sécurité et l'alignement des IA. L'objectif affiché est double : faire avancer l'état de l'art scientifique sur les risques liés aux modèles de langage avancés, et former la prochaine génération de chercheurs spécialisés dans ce domaine.

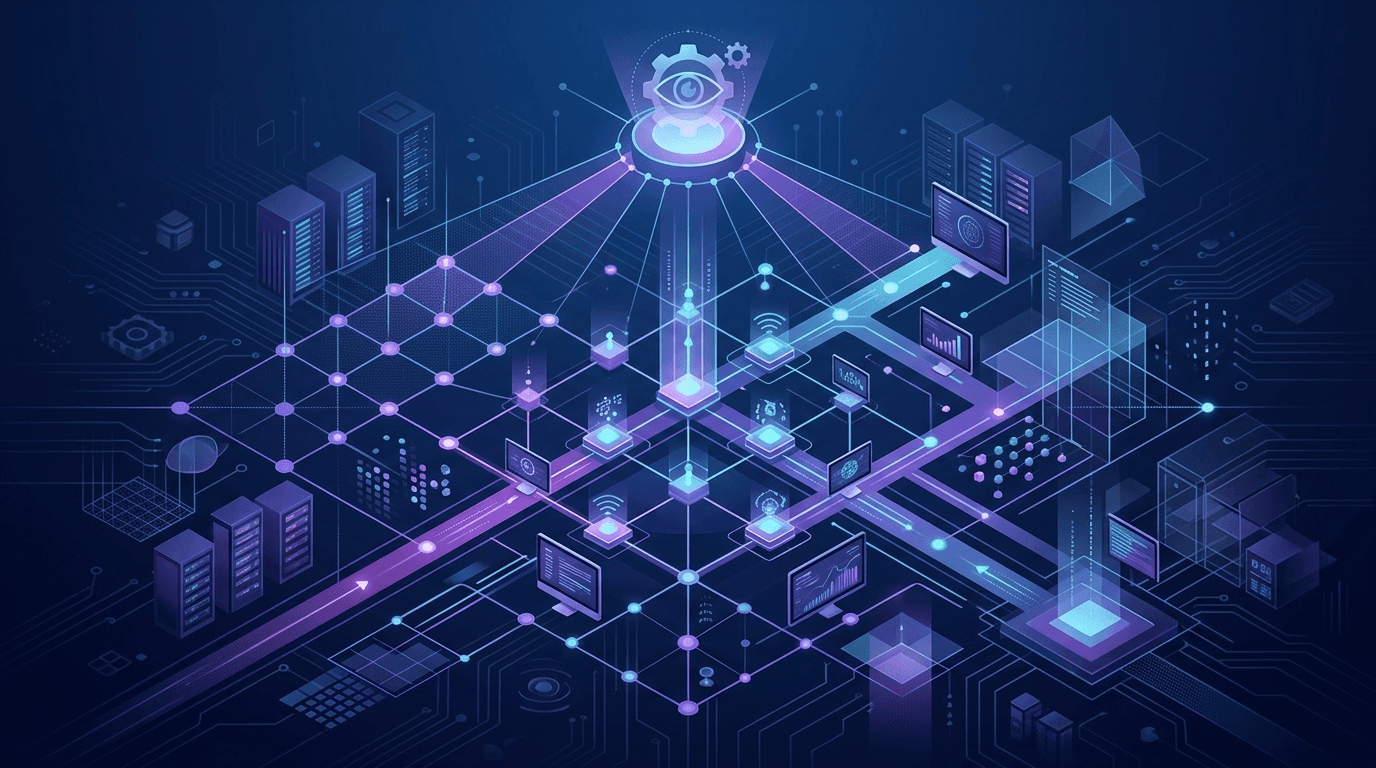

Concrètement, OpenAI s'engage à soutenir des chercheurs externes — issus d'universités, de think tanks ou travaillant de façon indépendante — pour qu'ils puissent travailler sur des questions critiques : comment s'assurer qu'un modèle d'IA fait bien ce qu'on lui demande ? Comment détecter et corriger des comportements inattendus ? Comment évaluer les risques systémiques à grande échelle ?

Pour les entreprises françaises, ce programme envoie un message fort : la sécurité de l'IA n'est plus une option ou un luxe réservé aux laboratoires de recherche. C'est une discipline en cours de professionnalisation rapide, avec des standards, des méthodologies et bientôt des certifications qui vont s'imposer dans les appels d'offres, les audits et les exigences réglementaires — notamment dans le cadre de l'AI Act européen.

De la recherche fondamentale aux cas d'usage en entreprise

On pourrait être tenté de considérer ce type d'initiative comme purement académique, sans lien direct avec le quotidien d'une PME lyonnaise ou d'une ETI bordelaise. Ce serait une erreur stratégique.

Prenons quelques exemples concrets :

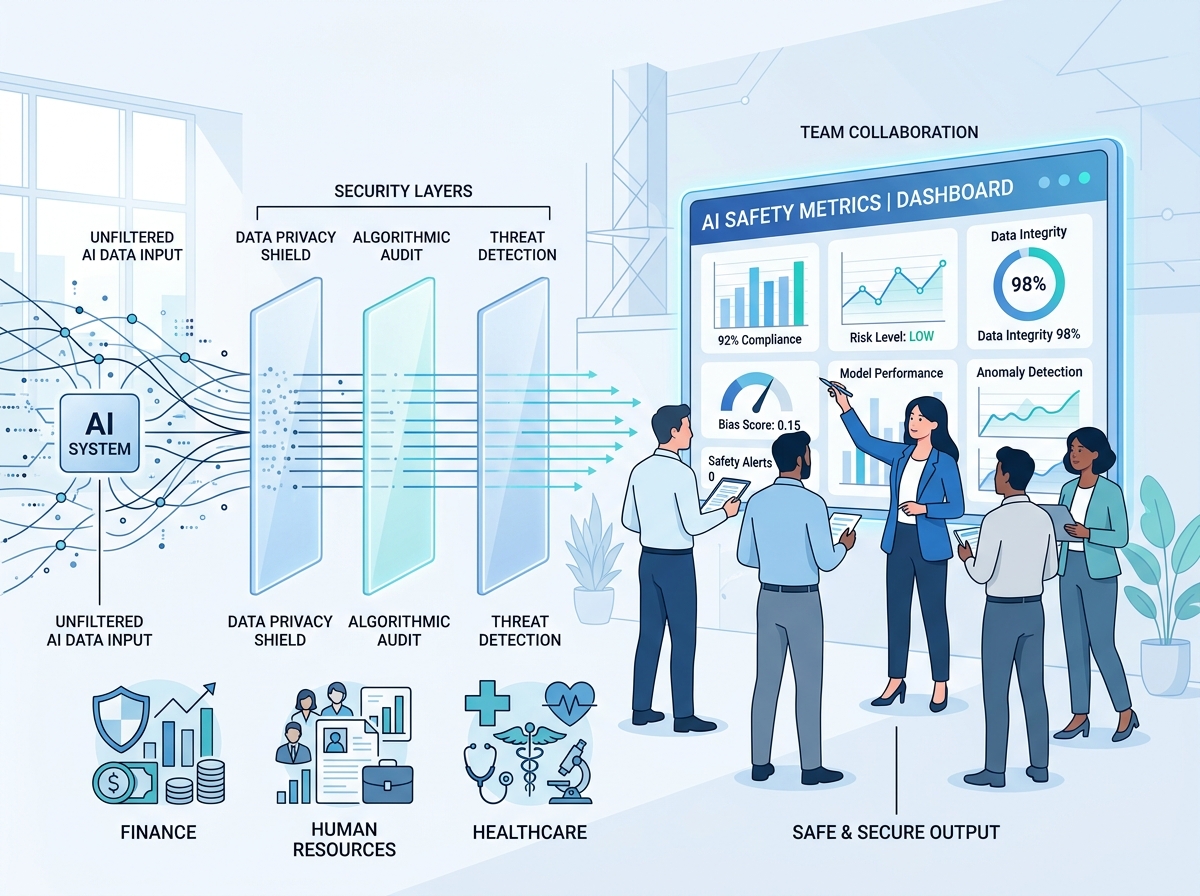

Dans un service RH, une entreprise utilisant un outil d'IA pour présélectionner des candidatures doit pouvoir démontrer que le modèle ne reproduit pas de biais discriminatoires. Les travaux sur l'alignement portés par des fellowships comme celui d'OpenAI contribuent directement à améliorer les méthodes d'audit et de correction de ces biais.

Dans un service client, un chatbot alimenté par un LLM peut, sous certaines conditions, produire des réponses inexactes ou inappropriées. Les recherches en safety permettent de développer des garde-fous techniques — les fameux guardrails — que vos prestataires pourront intégrer plus efficacement dans leurs solutions.

Dans le secteur financier ou de la santé, les exigences de traçabilité et d'explicabilité des décisions prises par des algorithmes sont déjà très élevées. Les avancées en matière d'alignement fournissent les fondations théoriques et pratiques pour répondre à ces exigences réglementaires croissantes.

En d'autres termes, chaque euro investi par OpenAI dans la recherche en sécurité se traduit, à terme, par des outils plus robustes, des frameworks d'évaluation plus solides et des pratiques sectorielles plus matures — dont vos équipes pourront directement bénéficier.

Gouvernance IA : passer d'une posture réactive à une posture proactive

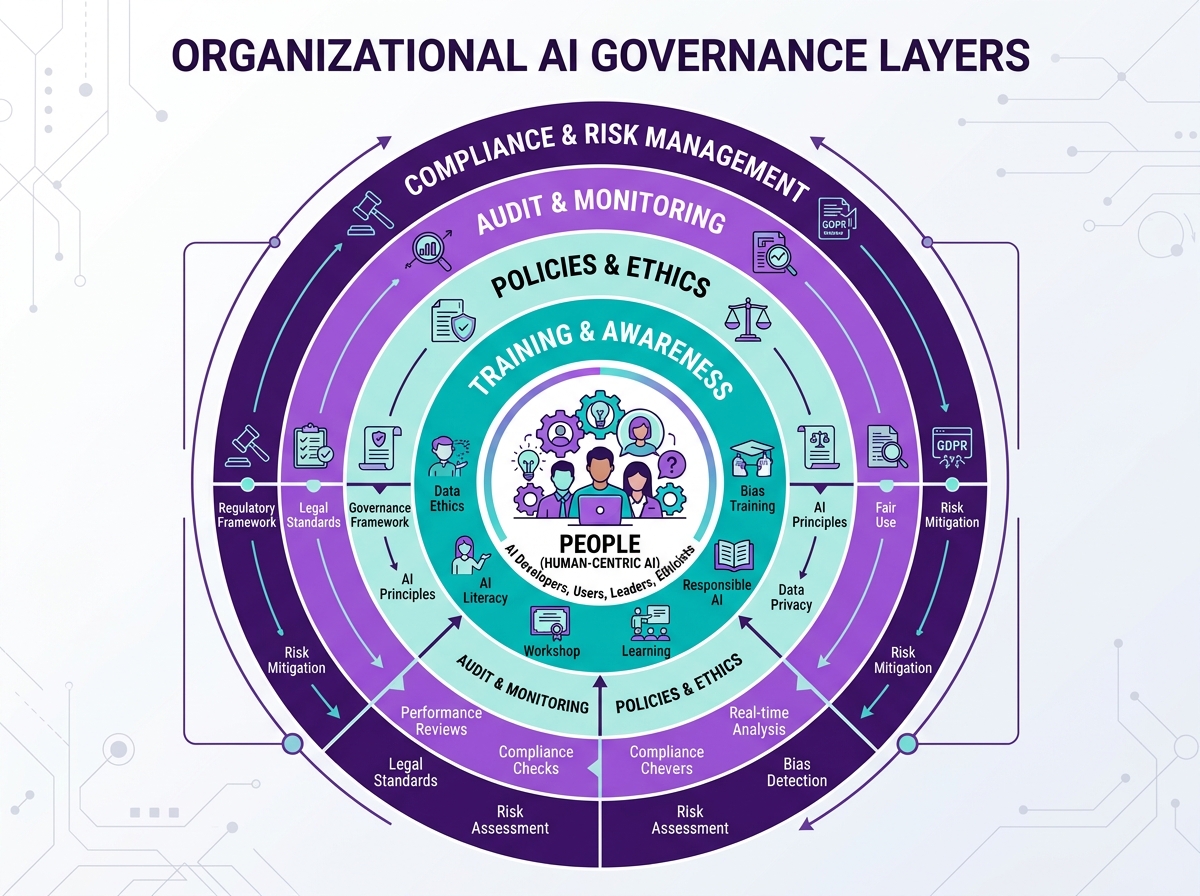

L'un des enseignements majeurs de cette annonce est qu'il ne suffit plus d'attendre que les éditeurs de solutions IA règlent les problèmes de sécurité à votre place. Les entreprises françaises les plus avancées dans leur transformation numérique commencent à intégrer une véritable gouvernance IA interne : comités d'éthique, politiques d'usage acceptables, processus de validation des modèles avant déploiement.

Cette évolution s'accélère sous l'impulsion de plusieurs facteurs simultanés :

- L'AI Act européen, dont les premières obligations s'appliquent déjà pour les systèmes à haut risque, impose des évaluations de conformité rigoureuses.

- Les attentes des parties prenantes — clients, investisseurs, partenaires — en matière de transparence algorithmique sont en forte hausse.

- Les incidents publics liés à des IA mal configurées ou mal supervisées ont un impact réputationnel désormais bien documenté.

Dans ce contexte, s'inspirer des méthodologies développées par des initiatives comme le Safety Fellowship — évaluation des risques, red teaming, tests d'adversité — n'est plus réservé aux grandes entreprises du CAC 40. C'est une démarche accessible, progressive, que tout dirigeant peut initier avec les bonnes ressources et le bon accompagnement.

Former vos équipes à la culture de la sécurité IA

La dimension formation est peut-être la plus structurante de toutes. Le Safety Fellowship d'OpenAI a pour ambition explicite de développer les talents de demain en matière de sécurité et d'alignement. Cette intention devrait résonner directement avec les directions des ressources humaines et les responsables de la formation continue en entreprise.

Former vos équipes à la sécurité de l'IA, ce n'est pas uniquement former des data scientists ou des ingénieurs. C'est aussi :

- Sensibiliser les managers métiers aux risques opérationnels liés à un usage non encadré des outils IA génératifs.

- Outiller les juristes et DPO pour évaluer les implications réglementaires des systèmes d'IA déployés.

- Donner aux équipes IT les clés pour auditer et monitorer les modèles en production.

- Encourager une culture du questionnement où tout collaborateur se sent légitime à signaler un comportement anormal d'un outil IA.

Chez Ikasia, nous accompagnons les entreprises françaises dans cette montée en compétences progressive. Nos programmes de formation combinent les fondamentaux théoriques de la sécurité IA avec des mises en situation pratiques adaptées à votre secteur. Parce que la meilleure façon de tirer parti des avancées comme le Safety Fellowship, c'est de disposer en interne des ressources humaines capables de les comprendre et de les appliquer.

L'annonce du OpenAI Safety Fellowship n'est pas une nouvelle réservée aux chercheurs en informatique. C'est un signal de maturité d'un écosystème qui se structure, se professionnalise et qui va progressivement imposer de nouveaux standards à toutes les organisations qui utilisent l'IA. Les entreprises françaises qui anticipent cette évolution aujourd'hui prendront une longueur d'avance décisive demain.

Vous souhaitez évaluer la maturité de votre organisation face aux enjeux de sécurité et de gouvernance IA ? Contactez nos experts sur ikasia.ai pour un diagnostic personnalisé ou pour découvrir nos formations adaptées à vos équipes.

Tags

Formations associées

Articles similaires

Agents IA en entreprise : comment surveiller leurs comportements pour éviter les dérives silencieuses

Lire

Les 5 principes d'OpenAI pour l'AGI : Ce que chaque dirigeant français doit comprendre pour préparer son entreprise

Lire

Hiérarchie des instructions dans les LLMs : comment OpenAI renforce la sécurité et le contrôle des IA en entreprise

LireEnvie d'aller plus loin ?

Ikasia propose des formations IA conçues pour les professionnels. De la stratégie aux ateliers techniques pratiques.