AI Act 2026 : Calendrier des obligations, Digital Omnibus et mise en conformité

L'AI Act européen est entré en application progressive depuis février 2025. Ikasia, cabinet de conseil IA et formation IA basé à Paris, France, publie ce guide actualisé du calendrier AI Act 2026 intégrant le Digital Omnibus de novembre 2025. Après les premières obligations (pratiques interdites, littératie IA), le calendrier se densifie avec les exigences pour les systèmes à risque élevé.

En bref : Février 2025 a marqué l'entrée en vigueur des pratiques interdites et de la littératie IA. Août 2026 impose les obligations pour les systèmes à risque élevé. Le Digital Omnibus apporte des simplifications pour les PME. Ikasia accompagne les entreprises françaises dans leur mise en conformité AI Act.

Récapitulatif : Ce qui a changé depuis l'AI Act initial

L'AI Act en bref

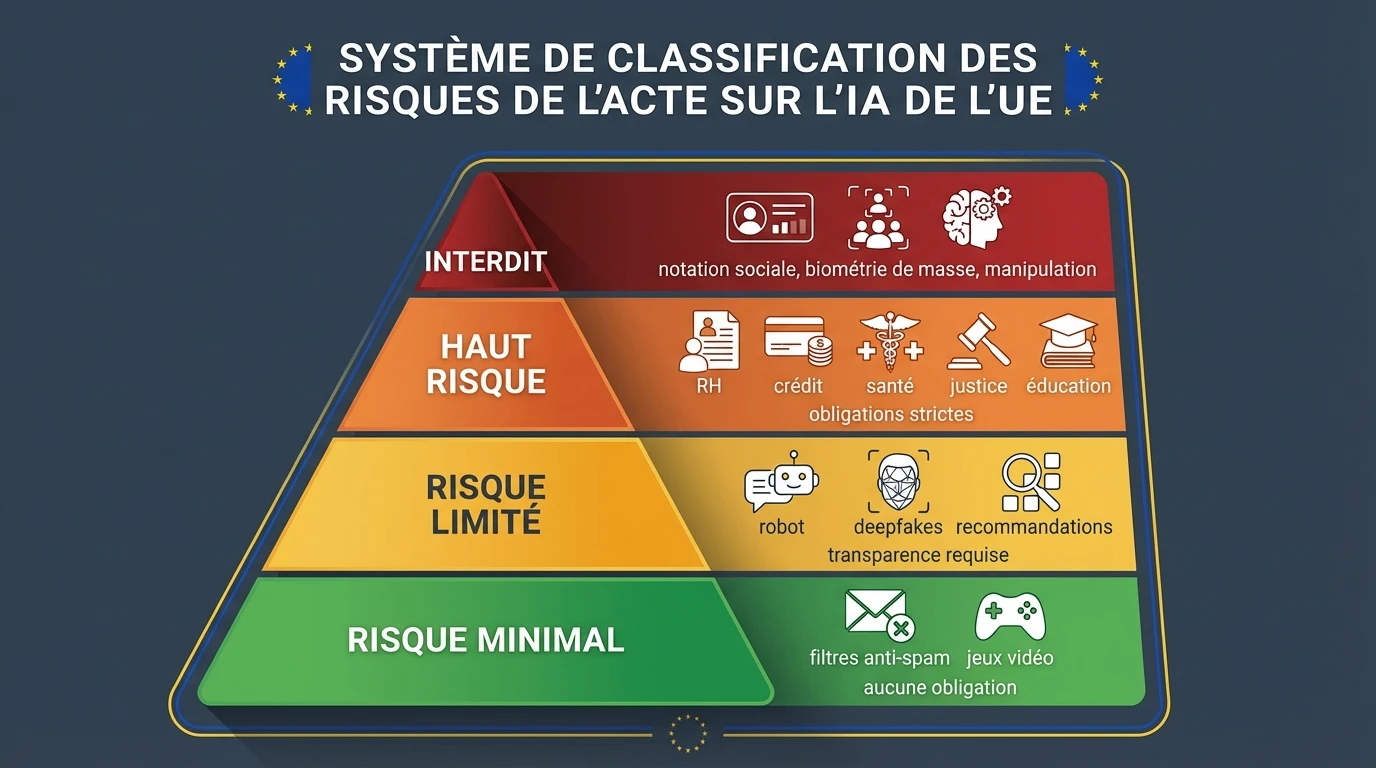

Adopté en mars 2024, l'AI Act (Règlement UE 2024/1689) est la première réglementation complète de l'IA au monde. Pour une présentation détaillée des fondamentaux, consultez notre article L'AI Act européen expliqué aux entreprises. Le règlement classe les systèmes IA en 4 niveaux de risque :

Les modifications depuis l'adoption

Actes délégués publiés (2025) :

- Précisions sur les systèmes à risque élevé

- Définition des pratiques interdites

- Modalités d'évaluation de conformité

Digital Omnibus on AI (novembre 2025) :

- Simplifications pour les PME

- Précisions sur les bacs à sable réglementaires

- Articulation avec les règlements sectoriels

Février 2025 : Pratiques interdites et littératie IA

Les 8 pratiques IA interdites

Depuis le 2 février 2025, les systèmes IA suivants sont totalement interdits dans l'UE :

1. Manipulation subliminale Systèmes utilisant des techniques subliminales pour altérer le comportement d'une personne de manière préjudiciable.

2. Exploitation des vulnérabilités Ciblage de personnes vulnérables (âge, handicap, situation sociale) pour influencer leur comportement.

3. Social scoring par les autorités Évaluation de la fiabilité des personnes basée sur leur comportement social ou caractéristiques personnelles.

4. Prédiction du risque criminel Profilage prédictif basé uniquement sur le profiling sans comportement criminel observé.

5. Scraping facial massif Constitution de bases de données de reconnaissance faciale par scraping d'images sur Internet.

6. Reconnaissance émotionnelle au travail/école Inférence des émotions sur le lieu de travail ou dans les établissements d'enseignement (sauf raisons médicales/sécurité).

7. Catégorisation biométrique sensible Classification des personnes selon race, orientation politique, religieuse, sexuelle via données biométriques.

8. Identification biométrique temps réel Reconnaissance faciale en temps réel dans l'espace public (sauf exceptions strictes : recherche de victimes, menaces terroristes).

L'obligation de littératie IA

Depuis février 2025, toute organisation déployant des systèmes IA doit assurer que son personnel dispose d'un niveau suffisant de maîtrise de l'IA (AI literacy).

Concrètement :

- Formation des utilisateurs de systèmes IA

- Compréhension des capacités et limites

- Sensibilisation aux risques et biais

- Documentation des formations dispensées

Qui est concerné :

- Fournisseurs de systèmes IA

- Déployeurs (organisations utilisant l'IA)

- Importateurs et distributeurs

Août 2025 : Obligations pour les GPAI

Qu'est-ce qu'un GPAI ?

Les General-Purpose AI Models (modèles d'IA à usage général) sont des modèles entraînés sur de grandes quantités de données, capables d'accomplir de nombreuses tâches.

Exemples : GPT-4, Claude, Gemini, Llama, Mistral.

Obligations depuis août 2025

Pour tous les GPAI :

- Documentation technique détaillée

- Politique de respect du droit d'auteur

- Résumé des données d'entraînement

Pour les GPAI à risque systémique : (Seuil : 10^25 FLOPs d'entraînement)

- Évaluation et atténuation des risques systémiques

- Tests adversariaux (red teaming)

- Reporting des incidents graves

- Protection cybersécurité adéquate

Impact pour les entreprises

Si vous utilisez des LLMs commerciaux (OpenAI, Anthropic, Google) :

- Le fournisseur est responsable de la conformité du modèle

- MAIS vous restez responsable de votre usage

Si vous développez/fine-tunez des modèles :

- Vous devenez potentiellement fournisseur GPAI

- Obligations de documentation applicables

Digital Omnibus on AI : Simplification ou complexification ?

Contexte de l'Omnibus

En novembre 2025, la Commission européenne a publié le Digital Omnibus on AI, un ensemble de mesures correctives suite aux premiers retours d'implémentation.

Les principales modifications

1. Allègements pour les PME

| Obligation | Avant Omnibus | Après Omnibus |

|---|---|---|

| Documentation technique | Complète | Simplifiée pour PME |

| Évaluation de conformité | Systématique | Proportionnée au risque réel |

| Bacs à sable réglementaires | Accès limité | Accès prioritaire PME |

2. Clarifications risque élevé

L'Omnibus précise les critères d'exclusion du risque élevé :

- Systèmes de support sans influence décisionnelle

- IA pour tâches procédurales étroites

- IA améliorant un processus sans le modifier substantiellement

3. Harmonisation sectorielle

Articulation clarifiée avec :

- MDR (dispositifs médicaux)

- Règlement sur les produits de construction

- Directive machines

- Règlement véhicules autonomes

Critique : Simplification ou recul ?

Arguments positifs :

- Réduction de la charge pour les PME innovantes

- Clarification des zones grises

- Accélération des bacs à sable

Arguments critiques :

- Risque de contournement par qualification "support"

- Affaiblissement des garanties pour certains systèmes

- Lobbying industriel ayant dilué les exigences

Calendrier complet des obligations AI Act

Tableau récapitulatif

| Date | Obligation | Concernés |

|---|---|---|

| Février 2025 | Pratiques interdites | Tous |

| Février 2025 | Littératie IA | Fournisseurs + Déployeurs |

| Août 2025 | Obligations GPAI | Fournisseurs de modèles |

| Août 2026 | Obligations risque élevé (hors produits) | Fournisseurs + Déployeurs |

| Août 2027 | Obligations risque élevé (produits) | Dispositifs médicaux, machines, etc. |

| 2027-2028 | Possible report (Digital Omnibus) | Certains systèmes risque élevé |

Focus sur août 2026 : Risque élevé

Systèmes concernés :

- IA de recrutement et gestion RH

- IA d'évaluation scolaire

- IA de scoring crédit (hors détection fraude)

- IA d'accès aux services publics essentiels

- IA d'aide à la décision judiciaire

Obligations à respecter :

- Système de gestion des risques

- Gouvernance des données (qualité, représentativité)

- Documentation technique détaillée

- Journalisation automatique (logs)

- Transparence et information des utilisateurs — voir aussi notre article sur l'IA explicable et la transparence XAI en 2026

- Supervision humaine effective

- Précision, robustesse, cybersécurité

- Évaluation de conformité (auto ou tierce partie)

Reports possibles : Risque élevé vers 2027-2028

Mécanismes de report

Le Digital Omnibus prévoit des reports potentiels pour :

1. Systèmes legacy (existants avant août 2025) Report jusqu'à août 2027 si :

- Système déjà en production

- Plan de mise en conformité documenté

- Pas de modification substantielle

2. Produits réglementés sectoriellement Report jusqu'à août 2027-2028 pour :

- Dispositifs médicaux (alignement MDR) — découvrez notre analyse de l'IA générative dans le secteur de la santé en 2026

- Véhicules et machines

- Produits de construction

3. Petits fournisseurs Délais supplémentaires pour :

- Entreprises < 50 employés

- Chiffre d'affaires < 10M€

- Sous réserve de plan de conformité

Attention : Les reports ne sont pas automatiques

Pour bénéficier d'un report, vous devez :

- Documenter votre situation

- Démontrer les efforts de conformité

- Ne pas avoir de non-conformités majeures

Checklist de conformité 2026 : 10 actions prioritaires

Immédiat (Q1 2026)

-

1. Inventaire des systèmes IA Cartographiez tous les systèmes IA utilisés ou développés.

-

2. Classification des risques Évaluez chaque système selon les catégories AI Act.

-

3. Vérification pratiques interdites Assurez-vous qu'aucun système ne tombe dans les 8 interdictions.

-

4. Programme de littératie IA Mettez en place les formations obligatoires.

Court terme (Q2 2026)

-

5. Documentation technique Préparez la documentation pour les systèmes à risque élevé.

-

6. Gouvernance des données Auditez la qualité et représentativité des données d'entraînement.

-

7. Système de logs Implémentez la journalisation automatique requise.

Moyen terme (Q3-Q4 2026)

-

8. Supervision humaine Définissez les procédures d'intervention humaine.

-

9. Évaluation de conformité Réalisez l'auto-évaluation ou planifiez l'évaluation tierce.

-

10. Information utilisateurs Préparez les notices d'information pour les utilisateurs de vos systèmes.

Anticiper les évolutions : Rester conforme dans la durée

Le contexte évolutif

L'AI Act n'est pas figé. Plusieurs évolutions sont attendues :

2026-2027 :

- Actes délégués complémentaires

- Jurisprudence des autorités nationales

- Codes de conduite sectoriels

2027-2028 :

- Révision prévue de l'AI Act

- Potentielles extensions ou restrictions

- Harmonisation internationale (US, UK, Japon)

Stratégie de conformité durable

1. Veille réglementaire continue

- Suivez les publications de l'AI Office européen

- Abonnez-vous aux newsletters juridiques IA

- Participez aux associations sectorielles

2. Gouvernance IA interne

- Désignez un responsable conformité IA

- Créez un comité IA incluant juridique, technique, métier

- Révisez trimestriellement votre inventaire

3. Approche "Privacy by Design" étendue

- Intégrez la conformité AI Act dès la conception

- Documentation continue, pas rétrospective

- Tests de conformité dans les pipelines CI/CD

4. Relations avec les autorités

- Identifiez votre autorité de contrôle nationale

- Participez aux bacs à sable réglementaires

- Anticipez les audits

Sanctions : Ce que vous risquez

Montants des amendes

| Violation | Amende maximale |

|---|---|

| Pratiques interdites | 35M€ ou 7% CA mondial |

| Non-conformité risque élevé | 15M€ ou 3% CA mondial |

| Informations inexactes aux autorités | 7,5M€ ou 1,5% CA mondial |

Autres conséquences

- Interdiction de mise sur le marché

- Rappel des systèmes non conformes

- Publication de la sanction (name & shame)

- Atteinte réputationnelle

Qui contrôle ?

- AI Office européen : GPAI et coordination

- Autorités nationales : Systèmes à risque élevé et limité

- En France : Probablement la CNIL (à confirmer par décret)

Notre accompagnement conformité AI Act

Chez Ikasia, nous proposons :

Audit conformité AI Act (3 jours)

- Inventaire et classification de vos systèmes IA

- Gap analysis par rapport aux obligations

- Roadmap de mise en conformité priorisée

Formation "AI Act pour décideurs" (1 jour)

- Comprendre les obligations par niveau de risque

- Identifier vos responsabilités

- Anticiper les évolutions réglementaires

Accompagnement conformité (3-12 mois)

- Pilotage du projet de conformité

- Documentation technique

- Préparation aux audits

Conclusion

L'AI Act 2026 entre dans sa phase opérationnelle. Après les pratiques interdites et la littératie IA en février 2025, les obligations pour les systèmes à risque élevé s'appliquent dès août 2026.

Les 3 priorités pour 2026 :

- Inventorier tous vos systèmes IA et les classifier

- Documenter la conformité (techniques, données, risques)

- Former vos équipes à la maîtrise de l'IA

Le Digital Omnibus a apporté quelques simplifications pour les PME, mais les exigences fondamentales demeurent. L'approche gagnante ? Anticiper plutôt que subir, en intégrant la conformité dès la conception de vos projets IA.

L'AI Act n'est pas qu'une contrainte réglementaire : c'est aussi l'opportunité de construire une IA de confiance qui sera un avantage compétitif durable. Pour évaluer concrètement le retour sur investissement de vos projets IA en conformité, découvrez notre guide sur le ROI de l'IA en entreprise en 2026.

Cet article vous a intéressé ? Découvrez notre Formation Éthique et Gouvernance IA — 2 jours pour piloter l'IA dans votre organisation.

Tags

Formations associées

Articles similaires

Checklist RGPD et IA : 10 points à vérifier avant de déployer un outil d'intelligence artificielle

Lire

Audit IA et conformité européenne : la checklist complète pour anticiper l'AI Act

Lire

IA Explicable (XAI) : Pourquoi la transparence algorithmique devient obligatoire en 2026

LireEnvie d'aller plus loin ?

Ikasia propose des formations IA conçues pour les professionnels. De la stratégie aux ateliers techniques pratiques.